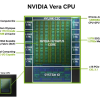

谷歌借机器学习技术增强了现实生活中的文本图像翻译体验

Google 正在通过机器学习(ML)驱动的附加功能,对其翻译服务带来新一轮升级。这使得用户能够更轻松地翻译现实世界中出现的文本,比如店面招牌、菜单、文档、名片等项目。更棒的是,新功能不会简单粗暴地将译文覆盖到原始文本的上方,而是利用 AI 生成的背景来重建像素,以便带来更自然的使用体验。

谷歌搜索副总裁兼总经理 Cathy Edwards 指出:

很多情况下, 单词的上下文组合 —— 比如背景图像 —— 真正为用户看到的内容赋予了更大的意义。

此时你肯定不希望图像中可能出现的重要背景,被翻译后的文本给遮盖住。

为了让进展更加顺利,谷歌还使用了被称作“生成对抗网络”(又称 GAN 模型)的机器学习技术。

在该技术加持下的“魔术橡皮擦”功能,可从 Pixel 智能机拍摄的照片中智能擦除不需要的对象。

但现在,Google 也将它运用到了翻译功能上。通过将译文融合到复杂的背景图像中,可为用户带来更加自然且无缝的使用体验。

在软件呈现的画面中,你能够像原文那样查看译文,而不是在当前图像上再添加一层遮挡。说到这,一些人可能已经联想到了该公司有意打造的新款 AR 眼镜。

Google 称,每月都有超 10 亿人次使用该公司的翻译服务,涉及超过 100 种语言的文本和图像。

今年开始,Google 还开始在公共场所,与少数员工和值得信赖的测试者们,一起评估他们的 AR 原型设备。

遗憾的是,该公司首次进军消费级智能眼镜领域的 Google Glass 产品,最终只是昙花一现。

最后,Google 没有分享其翻译功能的长期规划,仅表示相关功能会在今年晚些时候推出。