苹果新发布20个Core ML模型和4个数据集 全部开源供开发者们使用

苹果新发布 20 个 Core ML 模型和 4 个数据集,全部采用 Apache 2.0 开源许可证供开发者们使用。Core ML 模型的优势在于设备端本地运行无需网络,因此可以提供更快的响应速度并保持用户数据私密性。例如新发布的模型就支持去除图片背景,开发者可以轻松构建一个专门用于去除图像背景的本地应用。

苹果日前在知名 AI 模型托管平台 HuggingFace 上新发布了 20 个 Core ML 模型和 4 个数据集,这些模型全部采用 Apache 2.0 许可证进行开源,所有开发者均可使用。

这些采用 Core ML 框架的新模型在功能上都有所不同,不过侧重点都是在设备端本地运行 AI 模型执行任务,这样数据不需要上云解决潜在的隐私问题。

例如开发者可以构建一款用于图像分类的应用程序,在获得用户授权图库访问权限后,可以调用设备端模型进行处理;或者构建一个可以快速去除图像背景的应用程序,使用设备端模型也可以不上传图片,解决用户的隐私担忧。

当然采用设备端模型还有个好处就是响应速度会非常快,借助云端处理开发者需要提供性能更强的服务器才能支撑并发使用,而服务器响应和处理都需要使用,本地处理则不需要使用网络,因此也免去了响应时间问题。

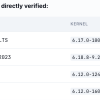

目前设备端运行 AI 模型最大的问题在于芯片性能,例如苹果推出的苹果智能仅支持 A17 Pro 和 Apple M 系列芯片,对于更旧的芯片还是得第三方开发者们提供支持,虽然这也会存在性能问题。

HuggingFace 创始人称这是一次重大更新,苹果将许多基于 Core ML 的新模型上传到了 HuggingFace 存储库,而 Core ML 模型严格在设备端运行无需网络连接,这可以让开发者的应用保持 “闪电般” 的速度,还可以确保用户数据的私密性。

有兴趣的开发者们可以访问 HuggingFace 上的苹果主页获取这些模型,苹果也为部分模型提供了论文描述,开发者可以根据论文说明快速了解这些模型的性能:https://huggingface.co/apple