击败GPT-4o、仅次于o1 英伟达重磅开源超强大模型--Nemotron

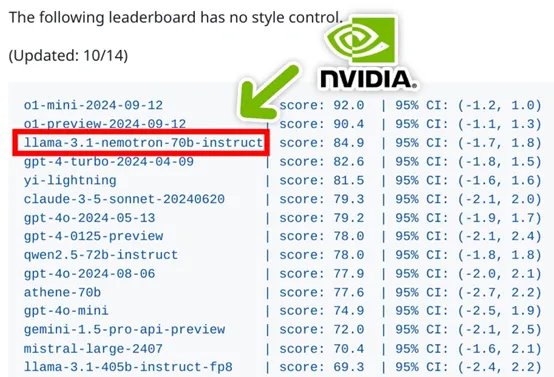

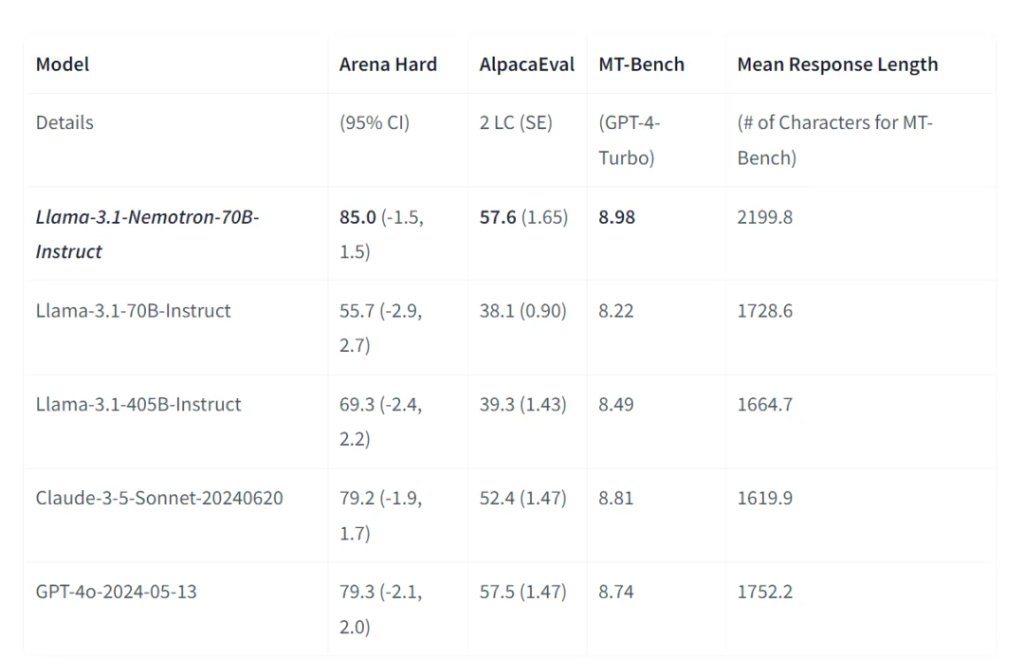

全球AI领导者英伟达(Nvidia)开源了超强大模型——Llama-3.1-Nemotron-70B-Instruct。根据测试数据显示,这个模型已经击败GPT-4o、GPT-4turbo、Gemma-2、Gemini-1.5、Claude-3.5 sonnet等140多个开闭源模型,仅次于OpenAI发布的最新模型o1。

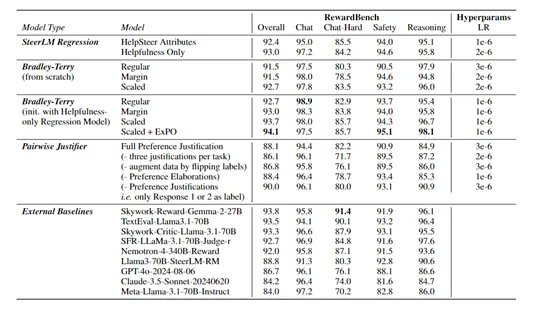

Nemotron的基础模型是基于Llama-3.1-70B开发而成,这个没什么新奇。但在训练的过程使用了一种新的混合训练方法,将Bradley-Terry和Regression一起用于训练奖励模型。

值得一提的是,英伟达把Nemotron的训练数据集也开源了,这对于开发同类型或超过Nemotron的模型非常重要,因为这个是使用混合训练方法的关键所在。

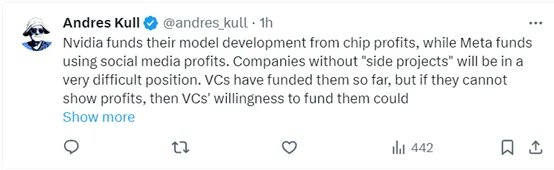

有网友表示,英伟达热衷于不断开源超强模型,一方面有大量资金资助他们的科研人员研发,另外主要目的还是为了卖GPU以及培养开发生态。而Meta依托他的社交帝国,在商业化和资金方面都不愁。

最愁的便是那些大模型初创企业了,钱拼不过这些巨头,商业落地和名气更不用提。所以,很多小企业可能会因为巨头的碾压,很快会出现资金断裂等各种问题。

很高兴看到AI领域的竞争,正在以惊人的速度推动行业向前发展。

这可是重磅开源。

为了新模型,买两个4090爽一下吧。

模型是免费的,但运行的硬件可不免费啊。

我正在测试这个模型,我是一个高级AI用户说说使用心得:在商业写作方面,似乎比Claude3和ChatGPT聪明一些。但它依然会犯一些错误,相比于普通的3.1 70b Instruct,确实更聪明。

Nvidia可以以1000倍更低的成本实现这一点。如果Nvidia真的原意这么做,那么将无人能与之竞争。

创新混合训练方法

在训练大模型的过程中,为了确保模型在实际使用中能够准确地理解并遵循用户的提示指令,准确进行翻译、文本生成、问答等任务,奖励模型发挥了很重要的作用,主要通过为模型的输出打分,指导模型生成更高质量的回答来实现。

目前,主流的奖励模型方法主要有Bradley-Terry和Regression两种:Bradley-Terry风格的奖励模型起源于统计学中的排名理论,通过最大化被选择响应和被拒绝响应之间的奖励差距。这种方法强调在给定的提示下,用户会选择哪个响应,从而为模型提供了一种直接的、基于偏好的反馈。

Regression则借鉴了心理学中的评分量表,通过预测特定提示下响应的分数来训练模型。这种方法允许模型对响应的质量进行更细致的评估,但可能不如基于偏好的方法直观。

但这两种方法都有明显的缺点,Bradley-Terry需要用户在两个响应中选择一个;而回归风格的模型需要评分数据,用户需要为每个响应打分才能帮助模型提升性能。所以,英伟达直接把两个模型的优点放在一起使用来解决这个难题。

首先是需要开发一个包含评分和偏好注释的数据集HELPSTEER2-PREFERENCE。研究人员是在HELPSTEER2基础上添加偏好注释。

这些偏好注释不仅包括用户在两个响应中选择一个的偏好方向,还包括用户对这种偏好的强度评分。为了确保数据的质量和可解释性,还要求注释者为他们的偏好提供书面说明。

在训练这种新型混合方法时,研究人员使用AdamW优化器来训练模型,通过引入权重衰减和梯度裁剪来提高训练的稳定性和效率。

为了进一步提高模型性能,使用了ExPO在训练过程中对模型的权重进行外推,可以进一步提高模型的性能。可以使模型在训练时更加关注那些差异较大的响应对,从而提高模型的区分能力。

此外,研究人员还进行了广泛的超参数搜索,以找到最佳的学习率和KL惩罚项。这些超参数对于模型的训练至关重要,因为它们直接影响到模型的收敛速度和最终性能。

HELPSTEER2-PREFERENCE数据集

为了开发这个多元化满足新的混合训练方法数据集,在数据注释的过程中,每一对回应都经过3—5名标注者的评价。这些标注者需要从多个维度对每个回应进行评分,包括有用性、准确性、连贯性、复杂性和冗长程度等。

为了更好地理解背后的原因,标注者还需要提供简短的文字说明,解释为何选择了某个回应作为更好的答案。这种方法不仅增强了数据的透明度,也为后续分析提供了丰富的上下文信息。

研究人员还使用了严格的数据预处理步骤来保证数据质量。例如,他们会识别出每个任务中相似度最高的三个偏好注释,然后取这三个注释的平均值并四舍五入到最接近的整数,以此作为该任务的整体偏好得分。

同时,为了排除那些标注者意见分歧较大的样本,研究人员们会过滤掉那些注释之间差异超过一定范围的任务。这些措施共同作用,有效提升了数据的可靠性和一致性。

根据测试数据显示,使用HELPSTEER2-PREFERENCE数据集训练的模型性能非常强,在RewardBench评测中达到了94.1的高分,超过了同期几乎所有其他模型的表现。