DeepSeek狂暴刷屏中 推理模型o1性能1/50价格

DeepSeek新发布远超预期,Reddit/X狂暴刷屏中。这次大事共有3件:开源DeepSeek-R1推理大模型,与o1性能相近。开源DeepSeek-R1-Zero,预训练模型直接RL,不走SFT,堪称语言模型的AlphaZero。开源用R1数据蒸馏的Qwen、Llama系列小模型,在某些任务上直接超过GPT-4o。

同时开放官方API,输入token(命中缓存)价格只有OpenAI o1的1/50,未命中缓存以及输出token价格约1/27。

论文中被反复热议的小细节就更多了:

R1-Zero模型在思考过程中涌现了“顿悟时刻”(aha moment),并自己学会为问题分配更多思考时间。

网友们开始推演接下来的剧情,如果顿悟的力量能被稳定利用……那就不知道会通向何处了。

再有,目前社区猜测OpenAI的o1-pro/o3可能使用了tree-of-agents方法,许多个o1的分身各自回答问题,再通过某种方式选出最优答案。

如果将DeepSeek-R1与Search-o1和Tree-of-Agents(大约50个智能体)结合起来,可以很小的成本获得与o3类似的性能,最终可能便宜数百倍。

这次DeepSeek总共开源6个在R1数据上蒸馏的小模型,其中蒸馏版Qwen-1.5B都能在部分任务上超过GPT-4o。

DeepSeek还特别更新了开源许可证,现在是MIT Lisence。

R1是开源的,R1数据想跑多少有多少,API可以用于蒸馏和微调,商用是免费的。

新的源神出现了!

01 DeepSeek新发布

OpenAI的o1系列模型率先引入了推理时扩展(inference-time scaling)的概念,通过增加思维链(Chain-of-Thought)推理过程的长度,在数学、编程、科学推理等任务上取得了显著的性能提升。

先前的研究探索了基于过程的奖励模型、强化学习、蒙特卡洛树搜索和束搜索等方法,但尚未有方法在通用推理性能上达到o1系列模型的水平。

DeepSeek-R1-Zero

DeepSeek团队迈出了利用纯强化学习提升语言模型推理能力的第一步。

他们的目标是探索大模型在没有任何监督数据的情况下,通过纯强化学习过程进行自我进化,从而获得推理能力。

具体而言,他们使用DeepSeek-V3-Base作为基础模型,并采用GRPO(Group Relative Policy Optimization)作为强化学习框架来提高模型在推理任务上的表现。

在训练过程中,DeepSeek-R1-Zero自然而然地涌现出许多强大而有趣的推理行为。

经过数千步的强化学习,DeepSeek-R1-Zero在推理基准测试中表现出色。

例如,它在AIME 2024上的pass@1得分从15.6%提高到71.0%,并且通过多数投票,得分进一步提高到86.7%,与OpenAI-o1-0912的表现相当。

DeepSeek-R1

然而,DeepSeek-R1-Zero也面临着可读性差、语言混杂等挑战。

为了解决这些问题并进一步提高推理性能,团队提出了DeepSeek-R1,它结合了少量冷启动数据和多阶段训练流程。

具体而言,他们首先收集数千条冷启动数据来微调DeepSeek-V3-Base模型。随后,他们进行了类似DeepSeek-R1-Zero的面向推理的强化学习。

当接近强化学习过程的收敛时,他们通过在强化学习检查点上进行拒绝采样,结合来自DeepSeek-V3在写作、事实型问答、自我认知等领域的监督数据,创建新的SFT数据,然后重新训练DeepSeek-V3-Base模型。

使用新数据进行微调后,该检查点还经历了一个额外的强化学习过程,考虑到所有场景下的提示。

经过这些步骤,他们获得了一个称为DeepSeek-R1的检查点,其性能与OpenAI-o1-1217不相上下。

R1数据蒸馏模型

DeepSeek团队进一步探索了从DeepSeek-R1蒸馏到更小的密集模型。使用Qwen2.5-32B作为基础模型,直接从DeepSeek-R1蒸馏的效果优于在其上应用强化学习。

这表明,更大的基础模型发现的推理模式对于提高推理能力至关重要。

他们开源了蒸馏的Qwen和Llama系列模型。值得注意的是,他们的蒸馏14B模型在推理基准测试中大幅超过了当前最先进的开源QwQ-32B-Preview,而蒸馏的32B和70B模型在密集模型中树立了新的推理任务基准。

最后,团队还把在实验过程中很多失败的尝试分享出来,防止后人踩坑。

在过程奖励模型、蒙特卡洛树搜索算法上,DeepSeek都没能获得进展。

不过他们也强调,只是他们失败了,并不意味着这些方法无法开发出有效的推理模型。

未来他们计划在以下方向继续投入研究:提升通用能力、解决语言混杂问题、优化提示词敏感问题,以及改进软件工程任务的性能。

02 One More Thing

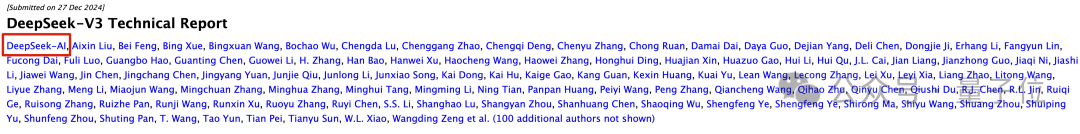

还有英语母语者挑起了论文中的遣词造句,认为很可能是大模型帮团队撰写的论文。

同时很多人注意到,在DeepSeek的许多论文里,“DeepSeek-AI”都出现在作者列表的第一位。