对话中国工程院院士:DeepSeek,究竟厉害在哪里?

1月27日,DeepSeek应用登顶苹果美国地区应用商店免费App下载排行榜,在美区下载榜上超越了ChatGPT。同日,苹果中国区应用商店免费榜显示,DeepSeek成为中国区第一。DeepSeek究竟厉害在哪里?

今日,中国工程院院士、清华大学计算机系教授郑纬民及多位AI圈人士在与新浪科技沟通中,指出了DeepSeek其成功出圈的关键所在。

目前,业界对于DeepSeek的喜爱与赞美,主要集中在三个方面。第一,在技术层面,DeepSeek背后的DeepSeek-V3及公司新近推出的DeepSeek-R1两款模型,分别实现了比肩OpenAI 4o和o1模型的能力。第二,DeepSeek研发的这两款模型成本更低,仅为OpenAI 4o和o1模型的十分之一左右。第三,DeepSeek把这一两大模型的技术都开源了,这让更多的AI团队,能够基于最先进同时成本最低的模型,开发更多的AI原生应用。

那么,DeepSeek是如何实现模型成本的降低的呢?

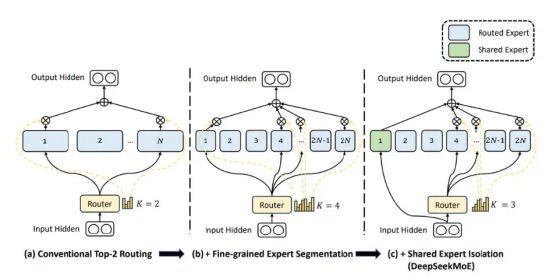

郑纬民指出,“DeepSeek自研的MLA架构和DeepSeek MOE架构,为其自身的模型训练成本下降,起到了关键作用。”他指出,“MLA主要通过改造注意力算子压缩了KV Cache大小,实现了在同样容量下可以存储更多的KV Cache,该架构和DeepSeek-V3模型中FFN 层的改造相配合,实现了一个非常大的稀疏MoE 层,这成为DeepSeek训练成本低最关键的原因。”

就技术层面而言,KV Cache是一种优化技术,常被用于存储人工智能模型运行时产生的token的键值对(即key- value数值),以提高计算效率。具体而言,在模型运算过程中,KV cache会在模型运算过程中充当一个内存库的角色,以存储模型之前处理过的token键值,通过模型运算计算出注意力分数,有效控制被存储token的输入输出,通过“以存换算”避免了多数大模型运算每次都是从第一个token开始运算的重复计算,提升了算力使用效率。

此外,据郑纬民透露,DeepSeek还解决了“非常大同时非常稀疏的MoE模型”使用的性能难题,而这也成了“DeepSeek训练成本低最关键的原因”。

目前,通过MoE混合专家模型提升AI大模型的专业认知能力正成为业界公认的有效手段,而且一个大模型的专家模型数量越多,模型就越稀疏,效率也越高,但专家模型变多可能导致最终生成的结果不太准确。

据郑纬民介绍,“DeepSeek比较厉害的是训练MoE的能力,成为公开MoE模型训练中第一个能训练成功这么大MoE的企业。”新浪科技了解到,为保证大规模MoE专家模型的均衡运行,DeepSeek使用了先进的、不需要辅助损失函数的、专家加载均衡技术,保证每个token下,少量专家网络参数被真正激活的情况下,不同的专家网络能够以更均衡的频率被激活,防止专家网络激活扎堆。

此外,DeepSeek还充分利用专家网络被稀疏激活的设计,限制了每个token被发送往GPU集群节点(node)的数量,这使得GPU之间通信开销稳定在较低的水位。