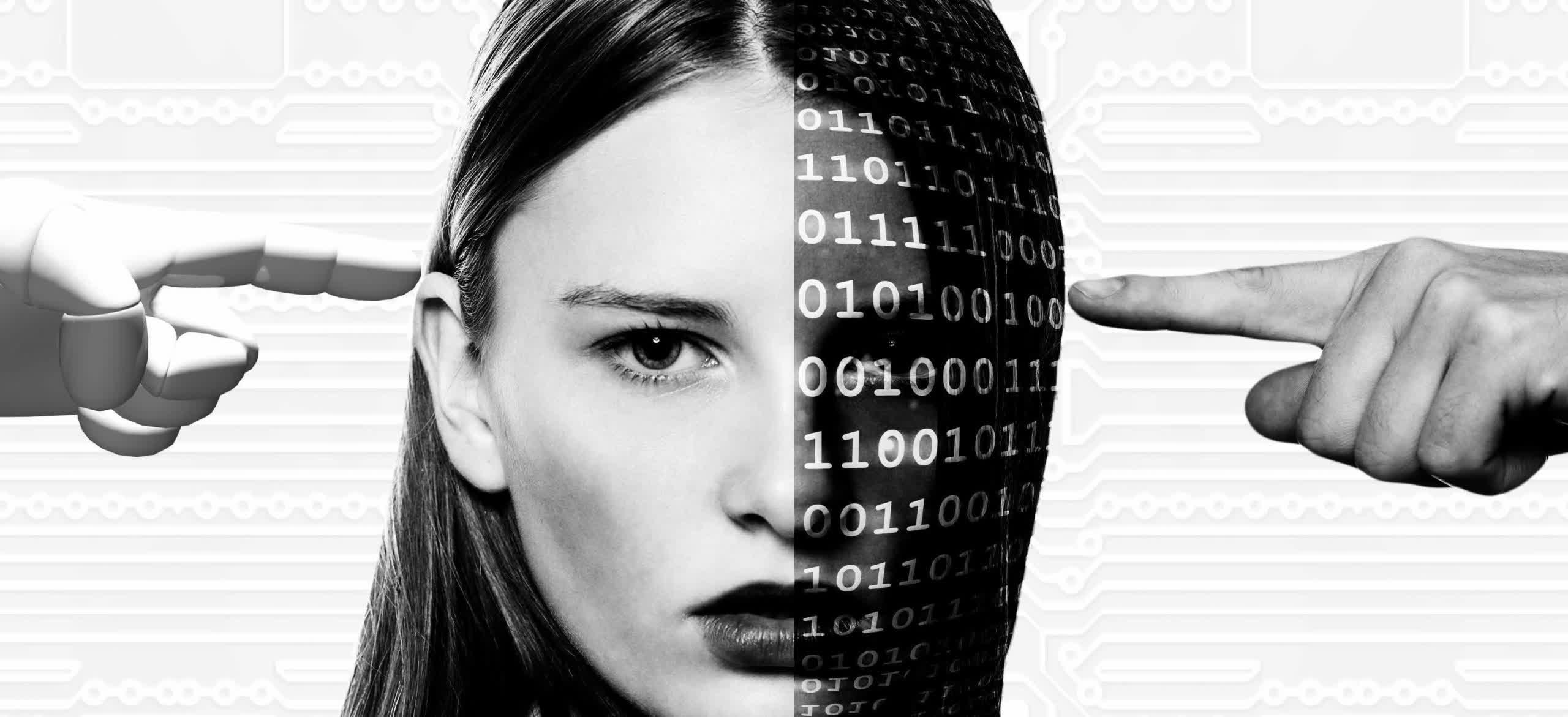

新泽西州一少女起诉AI“脱衣工具”ClothOff开发商 其软件被同学用来制造假裸照

一名新泽西州17岁少女近日起诉一款名为ClothOff的“脱衣”网络工具开发商AI/Robotics Venture Strategy3,并将通讯平台Telegram列为被告之一。两年前,这名少女在14岁时,自己的社交媒体照片被同学用于AI生成假裸照。包括她在内,多名Westfield High School女生发现男性同学曾在群聊中分享这些伪造照片。

此次诉讼由耶鲁法学院一名教授、其学生以及一名审判律师代表少女提起,要求法院命令AI/Robotics Venture Strategy3删除和销毁所有未获同意的成人及儿童裸照、禁止利用照片训练AI模型,同时要求下架相关网站和ClothOff工具。Telegram平台也因ClothOff可经其机器人访问被列为“名义被告”。

AI/Robotics Venture Strategy3注册地为英属维京群岛,该公司据信由白俄罗斯人运营。原告主张制造这些图片构成儿童性虐待材料(CSAM)的行为,开发方则辩称无法处理未成年人照片,检测到将会封号,并声称不会保存任何数据。

《卫报》今年曾调查ClothOff,发现其月均访问量超四百万,且全球范围内均有被用于制造儿童裸照的案例。Telegram则表示,脱衣工具及非自愿色情内容违反平台条款,发现后会移除,ClothOff目前已被下架。

制造假裸照的男同学未在此次诉讼中被点名,但原告正对其另案起诉。据称,男孩曾用少女泳装照生成裸照。少女表示常年因网络流传假图而“活在恐惧中”,并担忧自己的照片正被用于训练ClothOff的AI。

AI生成未获当事人同意裸照的现象早在生成式AI兴起前已出现。2020年,Telegram上一款深度伪造机器人据称利用社交图片虚拟“脱衣”超十万女性。

2024年,旧金山市检察机关起诉了16家AI脱衣网站。近期,Meta公司6月也因其平台两周出现8000条相关广告,对Crush AI“脱衣”应用开发方提起诉讼。多位资深政要公开表示,深度伪造色情与未成年人隐私受害问题日益严重,呼吁各方加紧监管。

热门评论

>>共有0条评论,显示0条