挑动千万网友情绪的“外卖平台离职软件工程师爆料” 竟是AI谣言

元旦刚过,海外社交平台Reddit上一篇自称揭露“美国某外卖平台算法黑幕”的匿名帖子迅速登榜。尽管相关海外外卖平台CEO连夜辟谣,且多项证据已指向内容系AI生成,相关讨论仍蔓延至国内社交网络。“绝望评分”“优先派单陷阱”等充满噱头的描述,成功引燃不少网民的愤怒情绪,甚至被掐头去尾、移花接木,变成指控国内外卖平台存在“骑手斩杀线”等压榨行为的证据。

1 月 8 日,据 NBC 等多家外媒报道,这篇“内部爆料”已被证实为AI生成的谣言,相关帖子也已删除。然而,这起事件并非孤例。过去一年,Reddit等平台已出现多起类似AI生成的“行业黑幕”帖。它们嫁接真实事件的框架、混用专业术语,在大众情绪间精准游走,极具迷惑力。

造谣因AI工具变得前所未有的廉价,虚假信息开始呈现“批量生产、快速迭代、识别困难”的新特征。而与民生紧密相关的外卖、快递等行业,正成为这类谣言的重灾区。

一份 AI 生成的“内部爆料”

1月2日,一位自称“Uber Eats软件工程师”的匿名用户在Reddit上发布长文,声称正在冒险揭露平台通过名为“绝望评分”(Desperation Score)的算法剥削骑手——系统会识别经济窘迫者,故意只推送低价订单。帖子还指控,所谓的“优先配送”服务实质是刻意延迟普通订单,以凸显优先订单的“快速”。

图说:该用户原帖中文翻译截图,目前原帖已删除

该帖细节“饱满”,引用DoorDash曾因挪用司机小费而支付高额和解金的真实案例,穿插大量技术术语。这种“半真半假”的叙事迅速获得超8.7万点赞,并在X平台收获超过3600万次浏览。

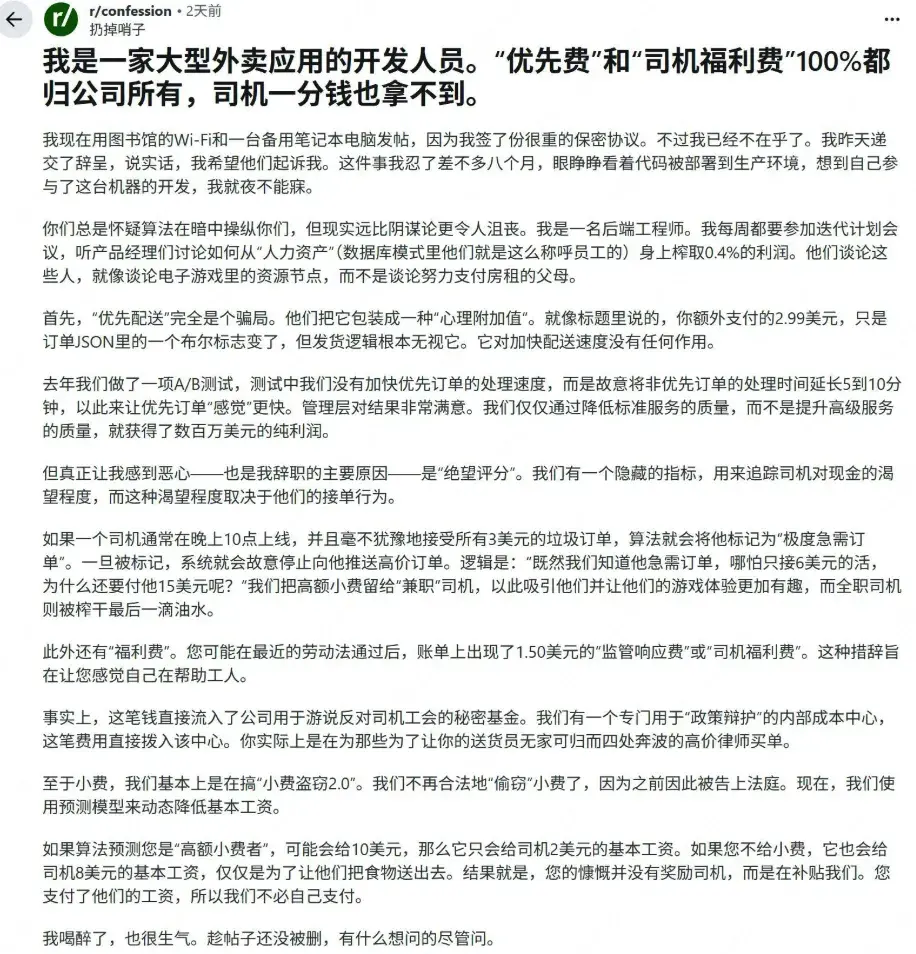

然而破绽很快浮现。当科技媒体Platformer记者Casey Newton要求核实身份时,发帖人发来的“Uber Eats工牌”被技术检测出带有AI生成特征数字水印。Uber官方随即否认,指出其统一工牌仅印“Uber”标识,不存在“Uber Eats”。

图说:据NBC报道:Reddit爆料者发给记者的“Uber Eats”工作证(右图),是拿NBC记者的证件照AI生成的

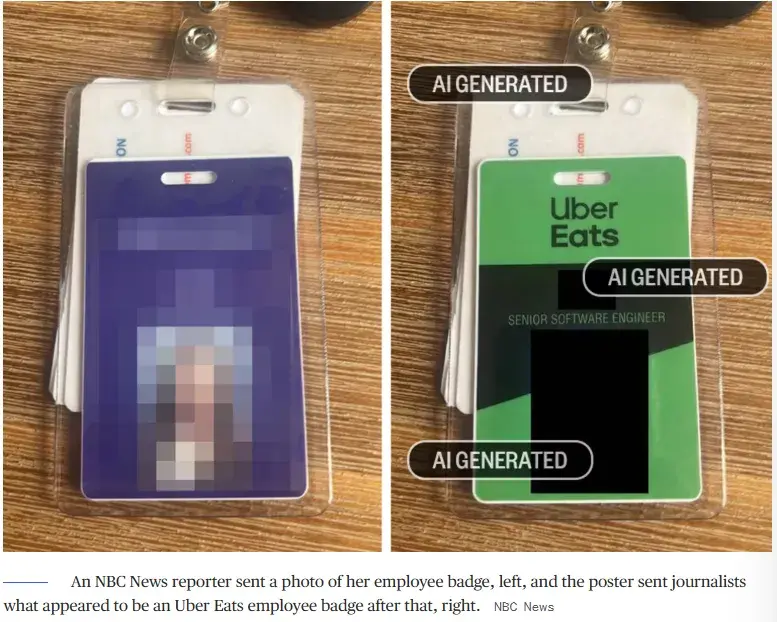

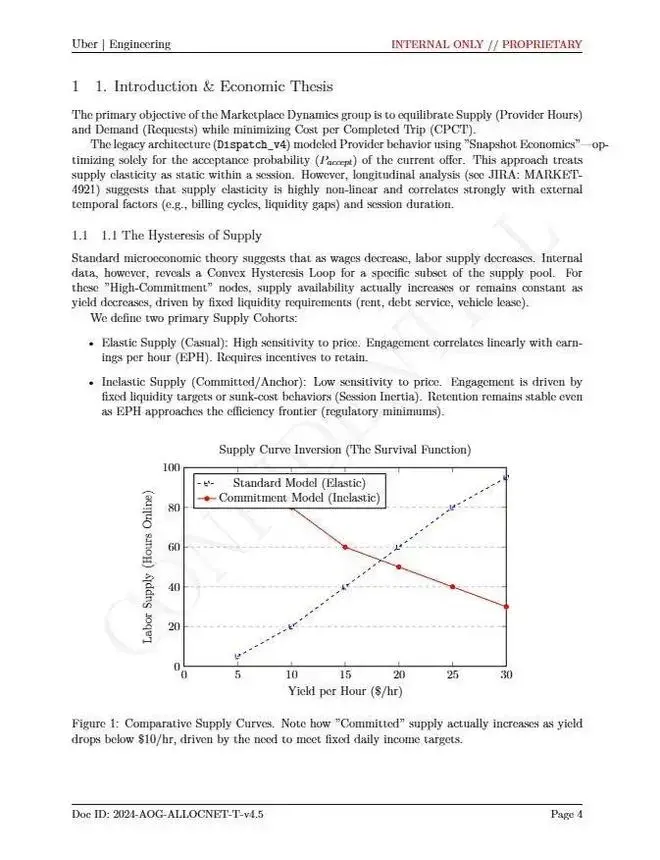

更荒谬的是其提供的18页“内部技术文档”。文件虽充斥示意图和数学公式,大部分内容都在描述发帖人提到的“绝望评分”背后的AI系统技术架构,虚构了“市场动态组·行为经济学部门”等机构,甚至提出“通过手机麦克风识别骑手、争吵声来推断他们的情绪状态”等方案。

图说:发帖人提供的“内部技术文档”截图

不过,面对记者对文件真实性的持续追问,发帖人以“风险过高”为由拒绝进一步验证,并催促记者尽快发布报道,随后删号消失,相关帖子也随即被删除。

在该帖子发酵期间, Uber与DoorDash 都已紧急辟谣。Uber称相关说法“完全错误”,DoorDash CEO徐迅明确否认公司存在“绝望评分”系统:“如果有人在公司里提议帖子里的举措,哪怕是容忍这类文化,我会立刻炒了他。”

1 月 8 日,来自 NBC 的最新报道显示,Reddit爆料者发给记者的“Uber Eats”工作证,实际上是拿NBC记者的证件照AI生成的,这也意味着“这是一则彻头彻尾的 AI 谣言”。

“绝望评分”被捏造的本质原因

尽管已被多方证伪,首次接触此事的网友中仍有许多人深信不疑。Reddit上有用户直言:“平台100%做过这些事,只是我证明不了”。

这种情绪表明,AI 谣言奏效不能简单归因于“造假”,更在于公众对平台算法长期积累的不信任感,“人们总是愿意相信自己相信的事情”,或者说 AI 谣言戳中了人们长期对“算法压榨”的愤怒情绪点。

过去几年,国外的外卖与出行平台确曾多次陷入争议。例如,DoorDash曾因挪用司机小费而支付上千万美元和解金,Uber也因算法不透明等问题在纽约达成2.9亿美元的天价和解。这些真实事件无形中为“绝望评分”这类虚构叙事提供了传播土壤。

该谣言中,“绝望评分”被描述为平台“精准拿捏”骑手的工具:若骑手长期接受低价单,系统便判定其为“极度急需”,停止推送高价单,陷入“越努力越低价”的循环。

这一叙述虽充满戏剧性,但其核心指控——差异化定价与区别化展示——在现实中却难以成立。

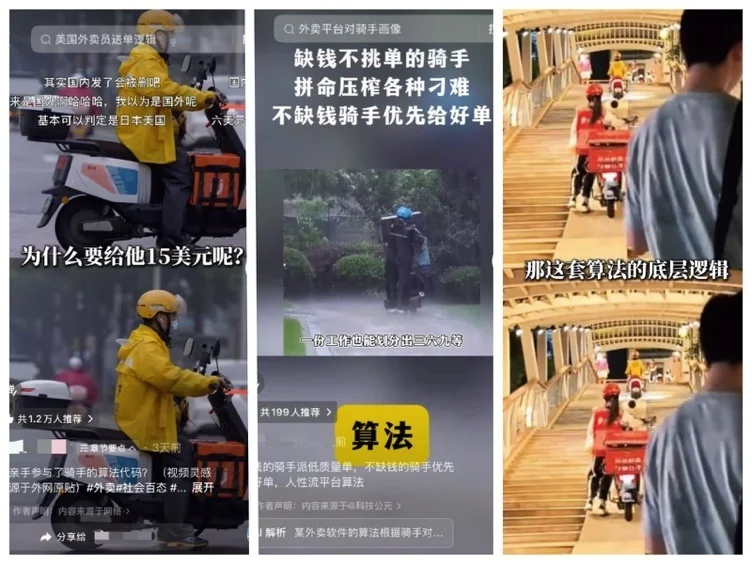

更让人匪夷所思的是:国内社交网络迅速涌现大量同质化内容,使用“能者多劳成为了一个笑话”“你越努力,距离斩杀线越近”等文案,通过移花接木替换国内外卖平台画面、渲染骑手艰辛,短时间内引发大量共鸣与转发,成为煽动对立与恐慌情绪的饵料。

图说:社交媒体平台上的相关嫁接视频

“做号党”将这则国外 AI 谣言嫁接成国内外卖平台的算法逻辑后,“绝望评分”这个新名词确实引发很多人的疑问:真的吗?

实际上,国内外卖平台其配送费调整主要基于天气、路况、供需等客观因素,而非骑手个人经济状况。且在国内自媒体发达环境下,骑手群体间很方便相互“对账”,目前并未出现“骑手被打标签只派低价订单”等情况。用户打赏全额直达骑手账户,平台无法干预,这也是支付监管的明确要求。

同时,主流外卖平台在规则设计上正趋向更公平、透明。以美团、淘宝闪购为例,2025 年平台已全面取消骑手超时罚款,转为以得分体系为核心的正向激励机制,并通过培训帮扶、优化调度、畅通申诉等方式提升骑手体验。算法逻辑也在逐步从效率优先向兼顾公平演进。公开资料显示,自2021年以来,美团已经连续十次对外公布算法改进的细则,如预计送达时间确定机制、订单分配机制等,持续推动算法公开和协商共治。

收入层面,平台已建立更为透明的机制。根据美团2025年第一季度财报,全国高频骑手月均收入区间为7230元至10100元,其中乐跑骑手等熟练群体收入更为突出。收入与工作时长、服务质量呈正相关,所谓“越努力单价越低”并不存在。优先配送订单通常通过合并顺路单、优化路径等方式实现效率提升,这种基于系统调度的整体优化,既提升了配送效率,也保障了骑手收入的合理性。

AI谣言的“进化”与灰色产业链

记者发现,Reddit上类似“外卖平台算法黑幕”的AI生成帖并非首次出现。它们往往嫁接真实事件框架,混用专业术语,极具迷惑力。苏黎世大学在Reddit上的一项秘密实验显示,AI生成内容在说服力上甚至可达人类的3-6倍。

“绝望评分”这类 AI 谣言之所以能迅速传播,很大程度上源于其内容天然契合情绪驱动。恐惧、愤怒等情绪极易激发公众的“一键转发”,而每一次互动又会“喂养”平台算法,推动内容获得更多曝光。若再经网络大V、媒体矩阵转发加持,谣言便会获得“裂变式”传播动能。

图说:社交平台上相关嫁接视频的留言评论截图

近年来,随着AI技术发展,造谣门槛大幅降低。借助开源模型,仅需输入提示词,几十秒内便能生成细节饱满的误导性内容,并利用社交平台算法偏好迅速收割流量。

更值得警惕的是,AI与谣言还在持续“进化”:它们学会模糊表述以规避屏蔽,甚至能模仿辟谣话术进行对抗性调整。根据清华大学新闻与传播学院发布的《揭秘AI谣言:传播路径与治理策略全解析》报告,AI生成谣言中,经济与企业类内容占比高达45.39%,其中外卖、快递等民生行业成为重灾区。

图说:经济与企业类AI谣言激增,餐饮外卖等民生行业成为重灾区

这类谣言的背后,是一条日益成熟的灰色内容产业链。长期以来,类似“外卖员被辱骂”“下跪求别差评”的虚假叙事屡见不鲜。它们通过刻意捏造冲突,煽动公众情绪:先打造人设,再编排剧情,接着拍摄传播,最终实现流量收割与变现。

吸引流量只是第一步。以自媒体“正面连接”报道中提及的 MCN 机构为例,其以“药物”作为“钩子”,刻意植入带有性暗示或道德争议情节,利用观众的好奇心与审判心理快速吸引互动。这类操作已形成固定模板,目标明确指向流量聚集。

流量随后被转化为多重收益。广告植入是最直接的变现方式之一,该团队每条广告报价约3000元,月接单可达20条左右,仅此一项月收入即近7万元。同时,平台流量分成亦构成稳定收益来源。此外,通过直播打赏、高价虚拟商品销售等手段,可将观众同情心直接“兑现”。

从剧本设计到广告植入,再到流量分红与直播变现,这条灰色产业链已形成收益闭环的运作模式。虚假内容不仅是“故事”,更是被精密计算和反复套现的流量商品。参与者为利益驱动选择性忽视信息污染,将不明真相的用户转化为“流量燃料”——每一次点击与转发,都在助长虚假信息传播。

虚假信息的泛滥不仅挑起对立、愤怒情绪,持续扭曲骑手等群体的公众形象,更是人为制造并放大社会矛盾,最终伤害的是现实中一个个具体的企业实体和劳动者,以及理性的公共讨论空间。

如何跑赢AI谣言的“速度赛”

识别AI谣言,本身已是一场硬仗。一个尴尬的现状是:用来鉴别的工具,自己就先“吵”了起来。记者将那则引爆风波的“爆料帖”同时提交几款主流AI检测工具进行分析,结果却出现明显分歧——Gemini、Claude等判断其很可能来自AI,QuillBot等则认为出自人工,ChatGPT的结论则模棱两可。这种不一致直观反映出AI内容识别技术尚处于发展阶段,单靠技术“一锤定音”,目前还“靠不住”。

在监管与平台层面,应对机制正在构建。相关部门正推动“生成式AI内容溯源标识”等治理措施,一些平台也在尝试新技术对 AI 生成内容进行识别,但目前来看,“AI 生成内容”等小字标识对于虚假信息传播并无显著遏制作用。

《新民周刊》曾指出,骑手成为焦点、“赛道”与“流量密码”,是平台、博主与公众“共谋”的结果——将骑手要么捧上神坛,要么踩在脚下。这种两极化关注,既源于社会对灵活就业新形态的陌生,也隐藏着对骑手身份的漠视与歧视,同时成为公众情绪的宣泄口,最终被平台追求极端流量的机制不断放大。

博眼球、激发对立情绪的虚假信息通过内容平台实现零成本、光速传播,平台已然成为谣言"温床"。若从根源治理,必须夯实内容平台主体责任,要求其做好内容审核和把关工作,并对不实信息的传播承担连带治理责任。

对公众而言,提升辨识能力尤为重要。中国互联网联合辟谣平台建议,可通过“查源头、看细节、验逻辑、用工具”等方式进行交叉验证,例如留意图片光影是否合理、AI生成常见瑕疵(如手指数量),注意信息中的逻辑矛盾,并善用权威信源进行复核。

在视频通话场景中,如怀疑对方为AI伪造,可要求其做“按压脸颊”等动作——目前Deepfake技术还难以真实模拟人脸受外力时的变形细节。一些看似“笨拙”的办法依然有效:如果一件事好得不像真的,它很可能就不是;以及,永远尝试寻找第二个信源。

算法并非“上帝视角的收割机”,而是需要不断校准的工具。治理AI谣言与流量黑产,也非一日之功,而是政府、平台、劳动者、公众持续互动、共同优化的长期进程。我们既要警惕技术滥用对信息生态的污染,也需保持理性,推动技术向善、机制透明——这或许才是数字时代应有的生态底色。