微软发布了其生成式人工智能模型 Phi 家族的最新成员。该模型被称为Phi-4,微软称它在多个领域都比前一代模型有所改进,尤其是数学问题的解决,这部分归功于训练数据质量的提高。

截至本周四晚,Phi-4 的可用性非常有限:只能在微软最近推出的 Azure AI Foundry 开发平台上使用,而且只能根据微软的研究许可协议用于研究目的。

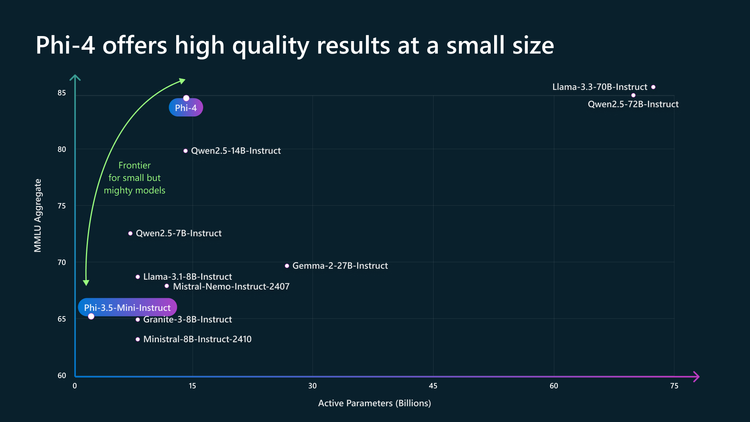

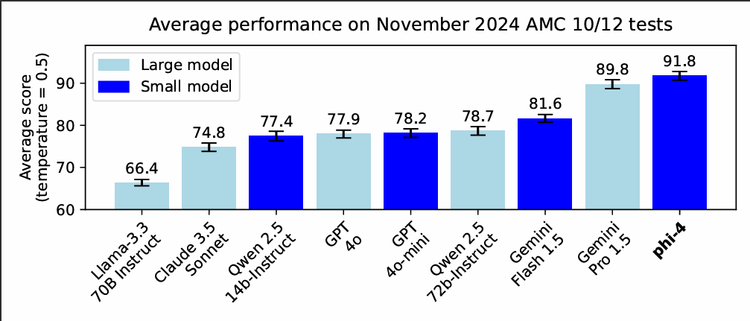

这是微软最新的小型语言模型,大小为 140 亿个参数,其竞争对手包括 GPT-4o mini、Gemini 2.0 Flash 和 Claude 3.5 Haiku 等其他小型模型。 这些人工智能模型通常运行速度更快、成本更低,但在过去几年中,小型语言模型的性能逐渐提高。

在这种情况下,微软将 Phi-4 性能的飞跃归功于使用了"高质量的合成数据集"、高质量的人类生成内容数据集以及一些未说明的后期训练改进。

如今,许多人工智能实验室都在更密切地关注合成数据和后期训练方面的创新。 Scale AI 首席执行官亚历山大-王(Alexandr Wang)在周四的一条推文中表示:"我们已经到了训练前数据墙的边缘,"这证实了过去几周有关该主题的多篇报道。

值得注意的是,Phi-4 是 Sébastien Bubeck 离职后推出的第一个 Phi 系列模型。 Bubeck 此前是微软的人工智能副总裁,也是该公司 Phi 模型开发的关键人物,他于今年 10 月离开微软并加入 OpenAI。