安全专家警告称实时语音深度伪造即将出现

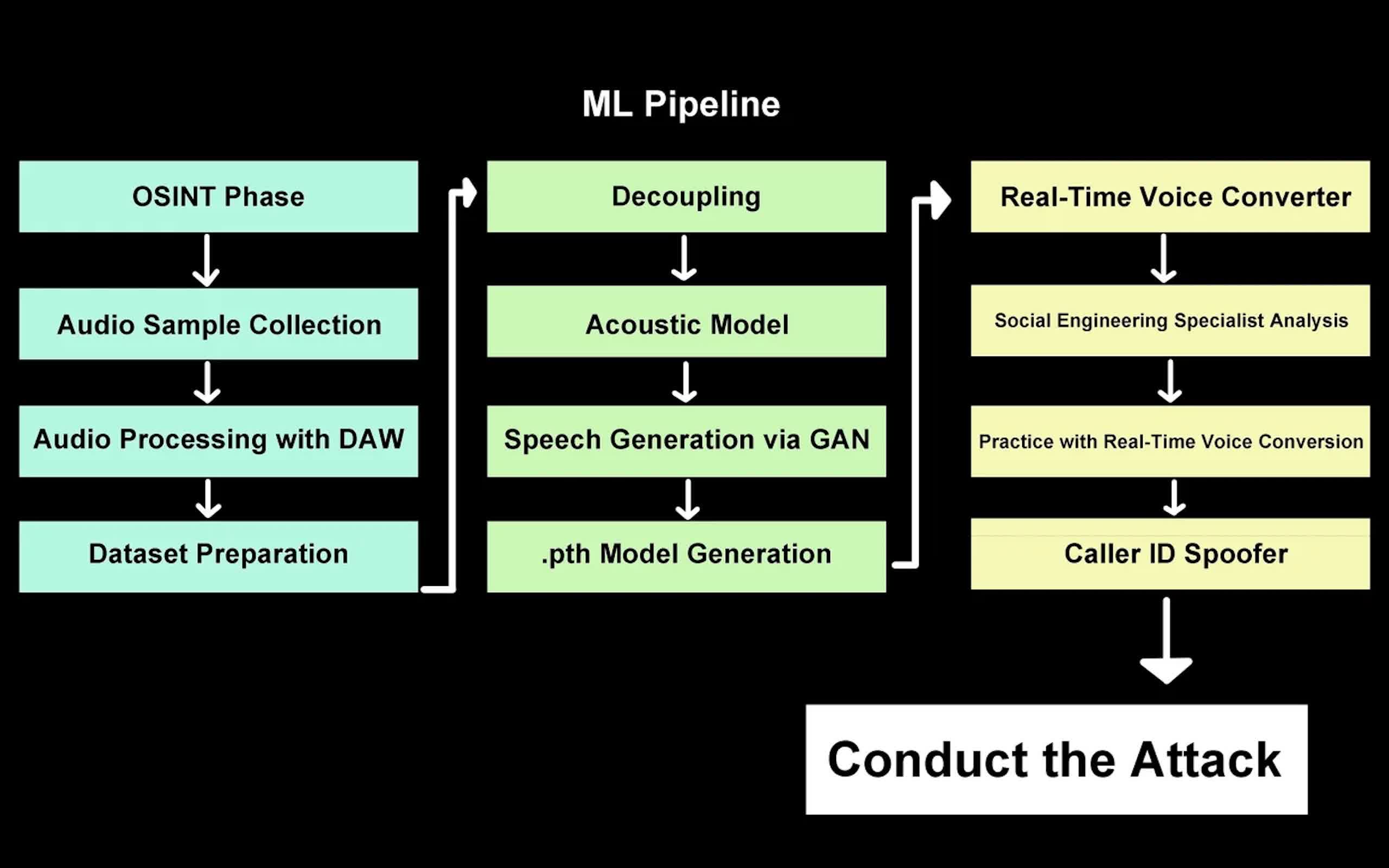

专家近日警告,实时语音深度伪造技术已经成熟,正带来新的网络安全风险。随着开源AI工具和经济实惠的硬件广泛使用,攻击者可以利用人工智能,在实时对话中伪装模仿任何人的声音,突破以往只能处理预录内容或需要较长处理时间的技术限制。

网络安全公司NCC Group最新研究显示,通过将AI语音模型与普通笔记本电脑或智能手机结合,仅需半秒延迟即可实现高质量的实时语音模仿。操作员仅需简单操作,即可在定制网页界面上启动语音克隆。这种“深度伪造语音钓鱼”攻击方式可以用较低配置的显卡完成,甚至利用普通设备的麦克风就能获得足够真实的效果。

此前的语音深度伪造技术通常需要较长时间训练语音数据,仅能生成预录片段,不适合实时互动。而此次突破则完全消除了语音模仿过程中的停顿和反应迟钝现象,大幅提升了攻击效率和隐蔽性。NCC Group安全顾问在实际测试中发现,结合来电显示欺骗后,这类攻击几乎每次都能骗过目标,电话语音验证冒充风险大幅提升。

虽然实时语音深度伪造愈发逼真,但同等级别的实时视频深度伪造仍存技术障碍,比如面部表情和语音不同步等易穿帮现象。专家举例称,一家公司甚至因遭AI伪造视频诈骗,向错误地址寄送了笔记本电脑,显示仅靠音视频通话已无法确保身份验证安全。

随着人工智能工具普及,专家呼吁采用更复杂的远程验证方法,例如在沟通中加入独特结构化信号或暗号,以防止深度伪造带来的社会工程攻击。否则,个人和组织都将面临更高风险的AI伪造欺诈威胁。