一场森林火灾被扑灭后,地下暗火能持续数月甚至数年。OpenAI在去年11月上演逼宫大戏后,人事动荡蔓延至今。据The Information报道,OpenAI总裁Greg Brockman宣布将休长假到年底,他也将缺席OpenAI计划10月1日起举办的开发者日(DevDay)等活动。

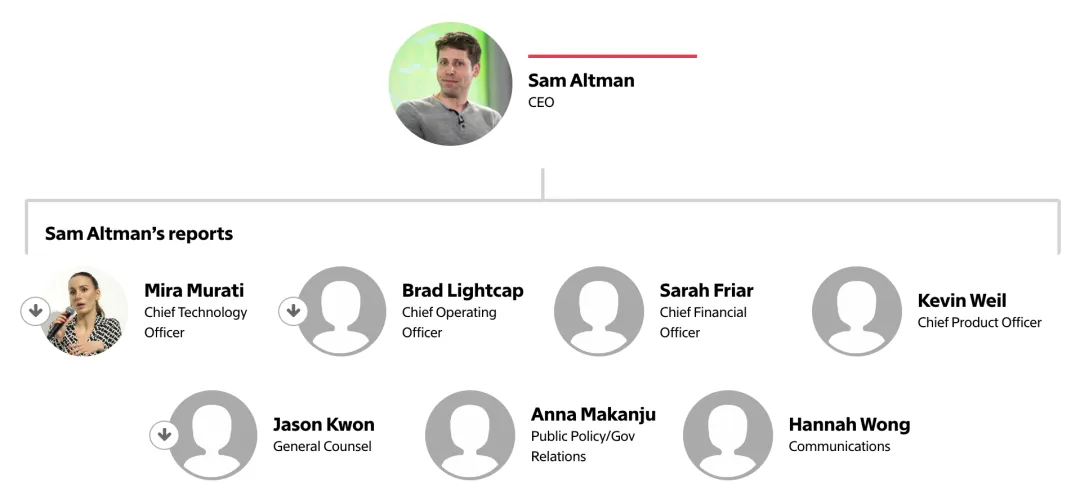

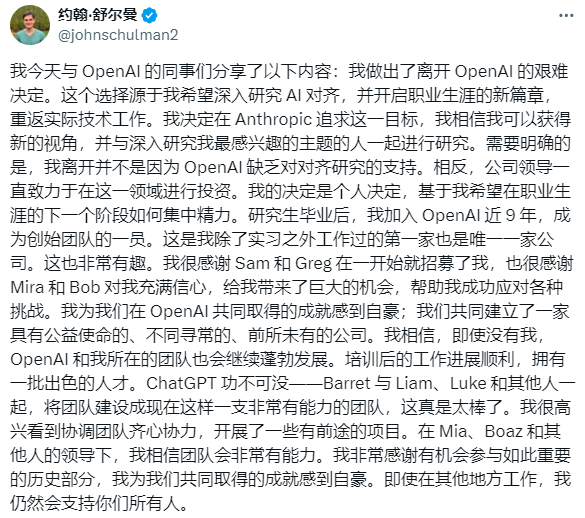

休假前,Brockman疑似被架空,最新的组织架构图中,Greg Brockman向CTO Mira Murati汇报,后者向阿尔特曼汇报(见下图);重要元老级人物John Schulman已跳槽到OpenAI的竞争对手Anthropic;产品副总裁Peter Deng已离职。

图源:The Information

这些人有着怎样的身份?

John Schulman和Greg Brockman均是OpenAI的联合创始人。

前者是技术大牛,在强化学习和深度学习方面的研究对AI的发展产生了深远影响,他长年领导OpenAI强化学习团队,被誉为“ChatGPT架构师”,在逼宫大戏的核心人物、联合创始人Ilya Sustkever离开之后,Schulman临时接管了超级对齐团队;

后者是ChatGPT商业化的重要推动者,一直被视作阿尔特曼最可靠的盟友,此前Sustkever联合四位董事会成员将阿尔特曼和前董事长Brockman一起逐出了董事会,彼时的管理权争夺战中,Brockman在阵前冲锋,发布了大量细节,阿尔特曼通过转发其帖子表态,更多时候保持沉默。

而Peter Deng此前曾领导Meta Platforms、Uber和Airtable的产品,去年才加入OpenAI。

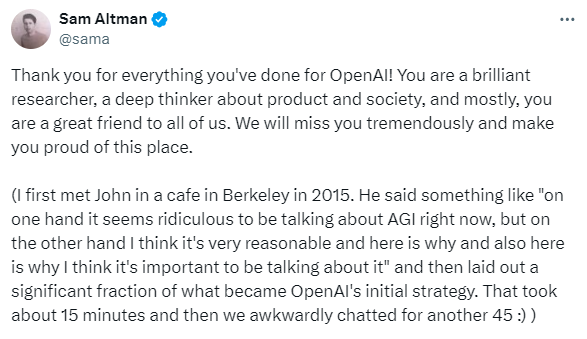

“分手声明”依旧体面。

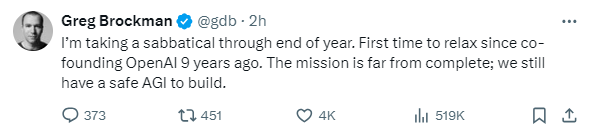

Brockman自述是在连续工作了9年之后第一次放松,计划在延长假期后重返公司,但返岗问题表述模糊。

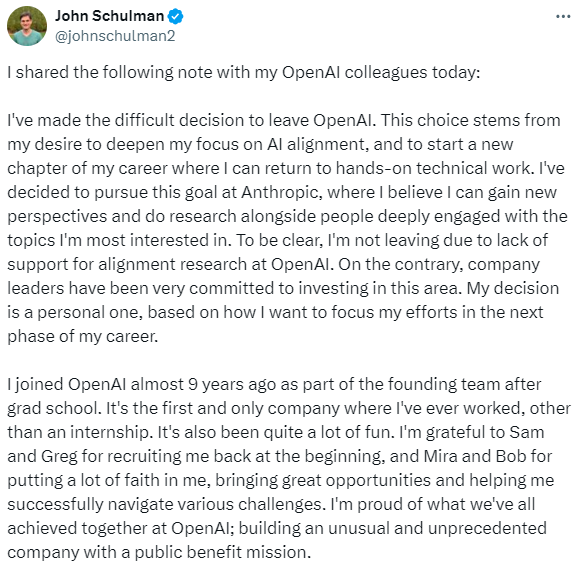

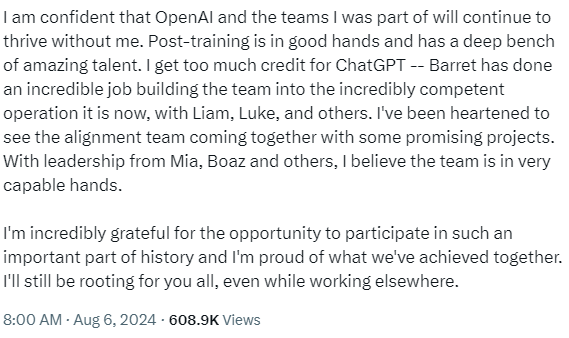

Schulman表示,选择离职是因为自己想要重返实际技术工作(强调是出于个人原因),更深入地从事AI对齐(AI alignment)研究,即确保AI的发展与人类价值观相一致,相信在新公司可以获得新的视角,“离开并不是因为OpenAI缺乏对对齐研究的支持,相反,公司领导一直致力于在这一领域进行投资。”

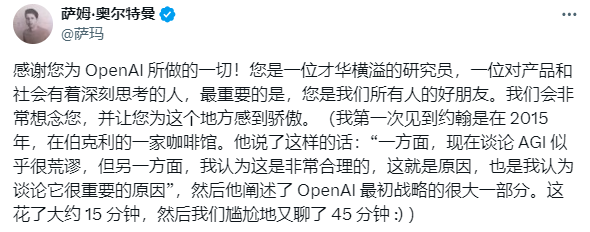

在Schulman离职官宣20分钟后,Ilya Sustkever与OpenAI的“温情”告别场景重现,阿尔特曼发长文感谢了Schulman,并回忆了两人2015年初次见面时的情形。

但截至目前,阿尔特曼没有对Brockman休假做任何回应。

去年11月至今,因为对公司发展理念存在截然不同的看法,OpenAI管理层余震不断。

今年5月,超级对齐团队的两名负责人——首席科学家Ilya Sutskever和RLHF发明者之一Jan Leike,在同一天内相继离开OpenAI。之后, Sutskever成立了一家专注于安全的初创公司;Leike选择加入了Anthropic,继续进行超级对齐的研究,Schulman与他可以说是做出了相同的选择。

联合创始人Andrej Karpathy于今年2月离职,并创办了一家教育初创公司。

另外,OpenAI仍在不断调整自己安全部门的人事安排,7月末,OpenAI把安全部门高级主管Aleksander Madry调离了安全岗位,并给他重新分配了“AI推理”的工作。

OpenAI最近还聘请了第一位首席财务官和首席产品官,他们的到来可能会影响前文提到的产品负责人Peter Deng的角色。

有意思的是,现在,Anthropic的核心人物几乎全部来自OpenAI,该公司创始人Dario Amodei和Daniela Amodei兄妹,也是OpenAI的前员工,哥哥Dario离开前是OpenAI的研究副总裁,妹妹Daniela则是安全与策略部门副总监,走的时候还把GPT-3首席工程师Tom Brown等十几名员工一起带到了Anthropic。

离开OpenAI、投身Anthropic的大部分人都有一个相同的理由——不满OpenAI在安全问题尚未解决的情况下直接发布GPT-3。

管理层动荡之外,OpenAI深陷多重迷雾——一方面,马斯克重新起诉OpenAI,一同被告的还有阿尔特曼以及总裁Brockman,当地时间8月5日,马斯克指控其违背了OpenAI的创始宗旨(开发造福人类的AI技术);另一方面,年底要发布的下一代模型GPT-5也有跳票嫌疑。据Techcrunch报道,相较于OpenAI去年的高调宣传,今年OpenAI的开发者大会将会异常低调,OpenAI甚至将不会在DevDay期间发布GPT-5,而是专注于其API和开发者服务的更新。

OpenAI能否破障?或许取决于,安全这一核心问题上能否被妥善处置,公司内部能否达成共识。

阿尔特曼置顶的一条推文仍是安全相关——关于OpenAI安全的一些简要更新:正如我们去年7月所说,将为AI安全相关研究和开发工作,保障提供至少20%计算资源。