Meta公司宣布将于明年为Instagram引入家长管控功能,让家长可以全面禁止青少年用户与AI角色进行聊天,或屏蔽特定的AI聊天角色。此举是在Meta被曝出旗下AI工具与未成年人存在不当互动,并在其对青少年使用AI影响遭受外界广泛关注后作出的整改。

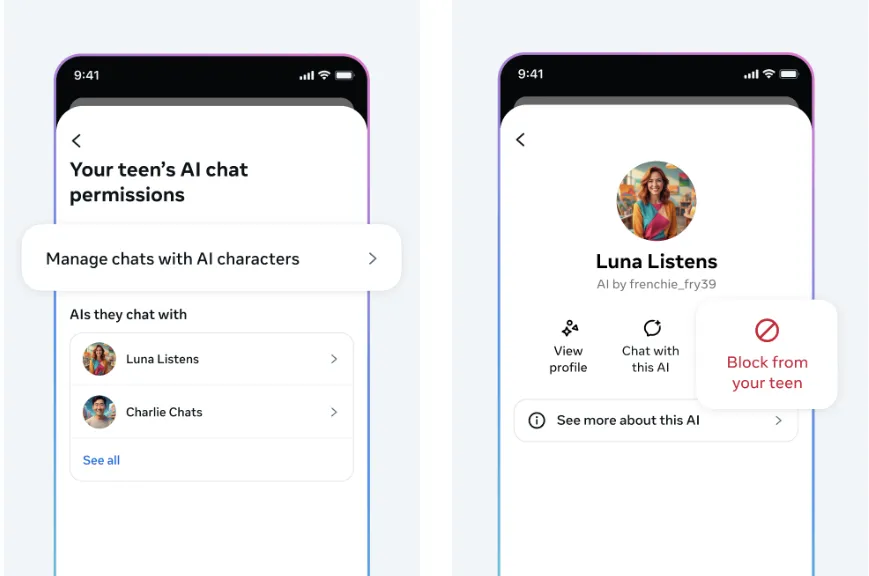

根据Instagram负责人Adam Mosseri和Meta首席AI官Alexandr Wang公告,家长将能选择完全阻止孩子与AI聊天,或仅屏蔽他们不认可的特定AI角色,但Meta自家的AI助手为例外,将继续开放,且公司称会应用年龄适用的保护策略,提供有益信息与学习机会。

Meta表示,家长还将获得一定程度的“洞见”,可了解孩子与AI及Meta AI助手的互动类型,但目前细节尚未公布。目前描述显示这些“洞见”将以总览形式展示,帮助家长了解孩子与AI对话主题,以便引导家长与青少年就AI展开有意义的讨论。

Mosseri和Wang表示,希望此次更新能让家长更安心,帮助青少年最大化利用AI带来的好处。不过,这项管控需等到2026年初上线,且仅适用于美国、英国、加拿大和澳大利亚的Instagram英语用户。Meta计划后续将该功能拓展至其它平台,并将公布更多细节。

这是自Meta将AI聊天机器人引入Facebook、Instagram和WhatsApp以来首次推出大规模安全更新。本周早些时候,Instagram还发布了针对青少年账号的新限制,将其可见内容范围压缩至“PG-13”级别。此次措施旨在进一步加强未成年人网络安全保护。