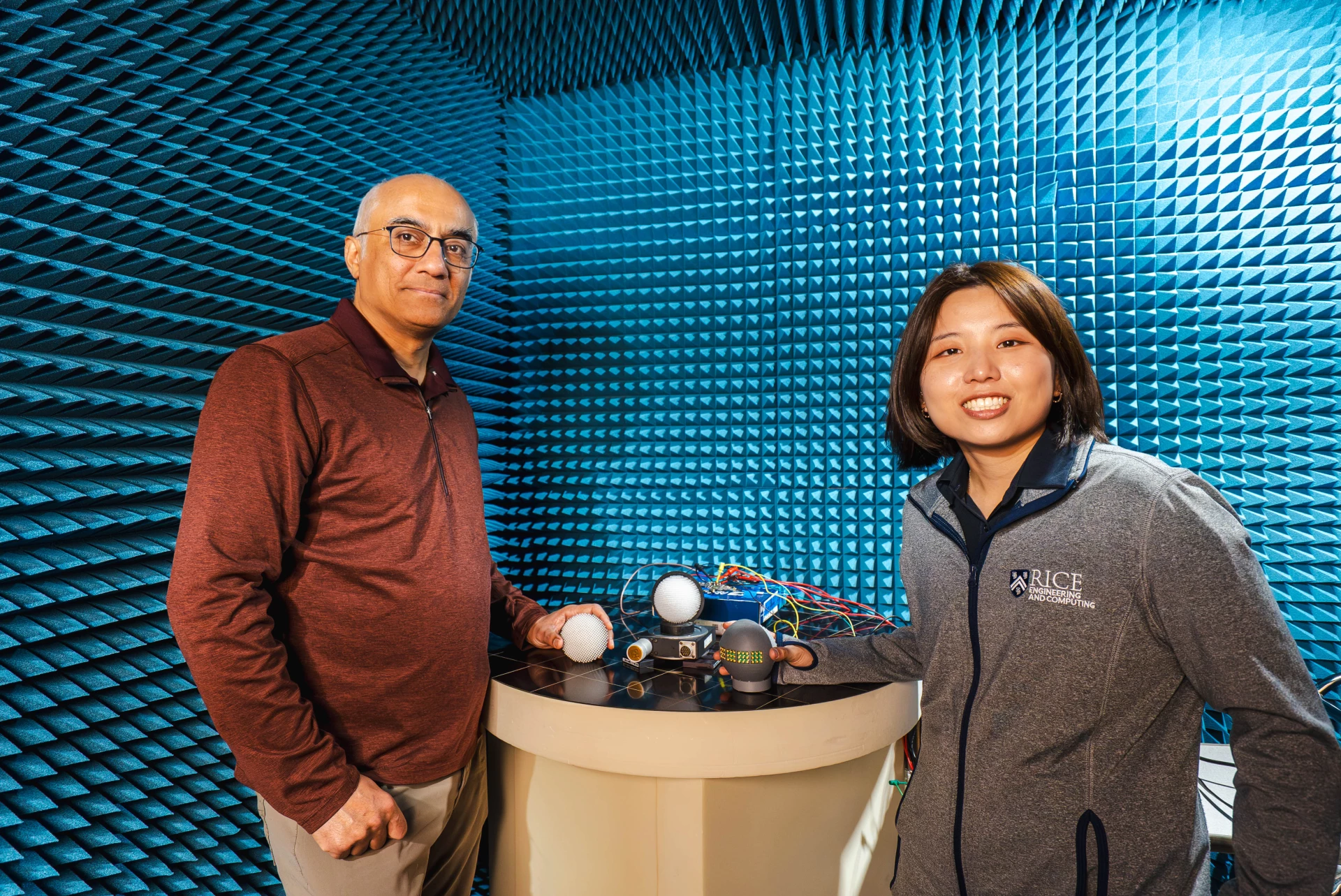

EyeDAR路侧雷达为自动驾驶补上“第三只眼”

美国莱斯大学团队近日推出一种名为 EyeDAR 的新型路侧雷达系统,有望为自动驾驶汽车提供类似“第三只眼”的扩展感知能力。 研究人员表示,这一技术通过部署在道路基础设施上的毫米波雷达装置,将关键交通信息回传车载系统,从而显著提升自动驾驶车辆的环境感知精度和安全冗余。

现有自动驾驶主要依靠车载摄像头、激光雷达(LiDAR)和传统雷达协同工作:摄像头负责识别行人、车辆和交通标志,LiDAR 通过激光脉冲构建高精度三维点云,弥补视觉和雷达在空间深度感知上的不足,但两者均易受雨雪、雾霾等恶劣天气影响。 雷达则通过发射和接收无线电波,实现不依赖光照和天气的目标探测。 然而,在实际道路环境中,被探测物体往往只反射少量信号,大量雷达波会向四周散射,导致车载雷达接收到的信息不完整,难以及时准确识别被遮挡或部分遮挡的行人和车辆等潜在风险。

随着自动驾驶卡车、配送机器人等逐步走向商业化,传感器在复杂路况下“看不清、看不远”的局限,正日益被视为安全短板。 莱斯大学团队尝试将感知体系从车载扩展到路侧基础设施,通过 EyeDAR 弥补盲区和信息缺口。 这一装置采用低功耗毫米波雷达设计,可安装在红绿灯、交通标志牌、广告牌等路侧设施上,将原本散射到环境中的反射波“收集”起来,转化为对周边交通参与者更加完整的描述,并回传给车辆的车载雷达系统。

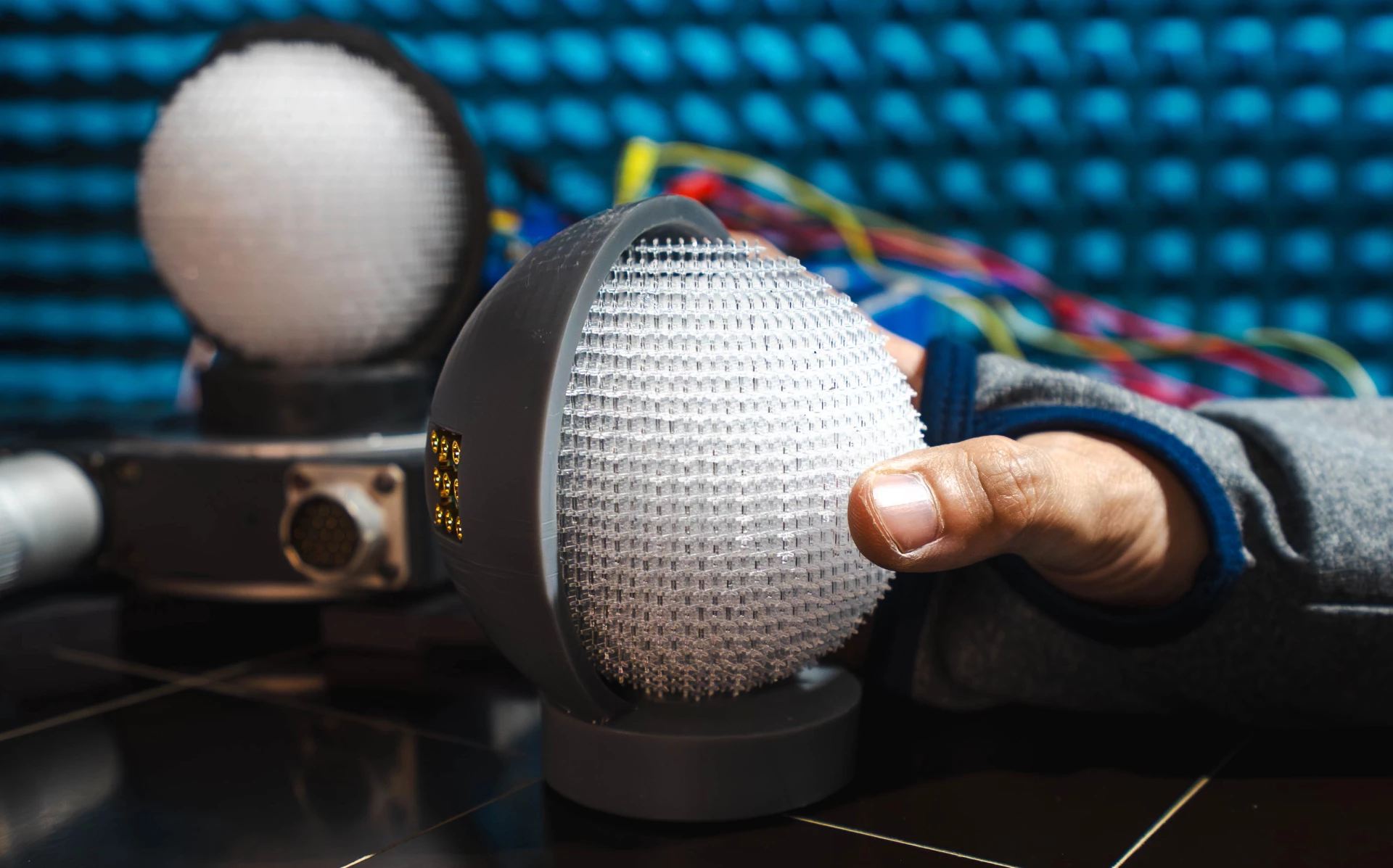

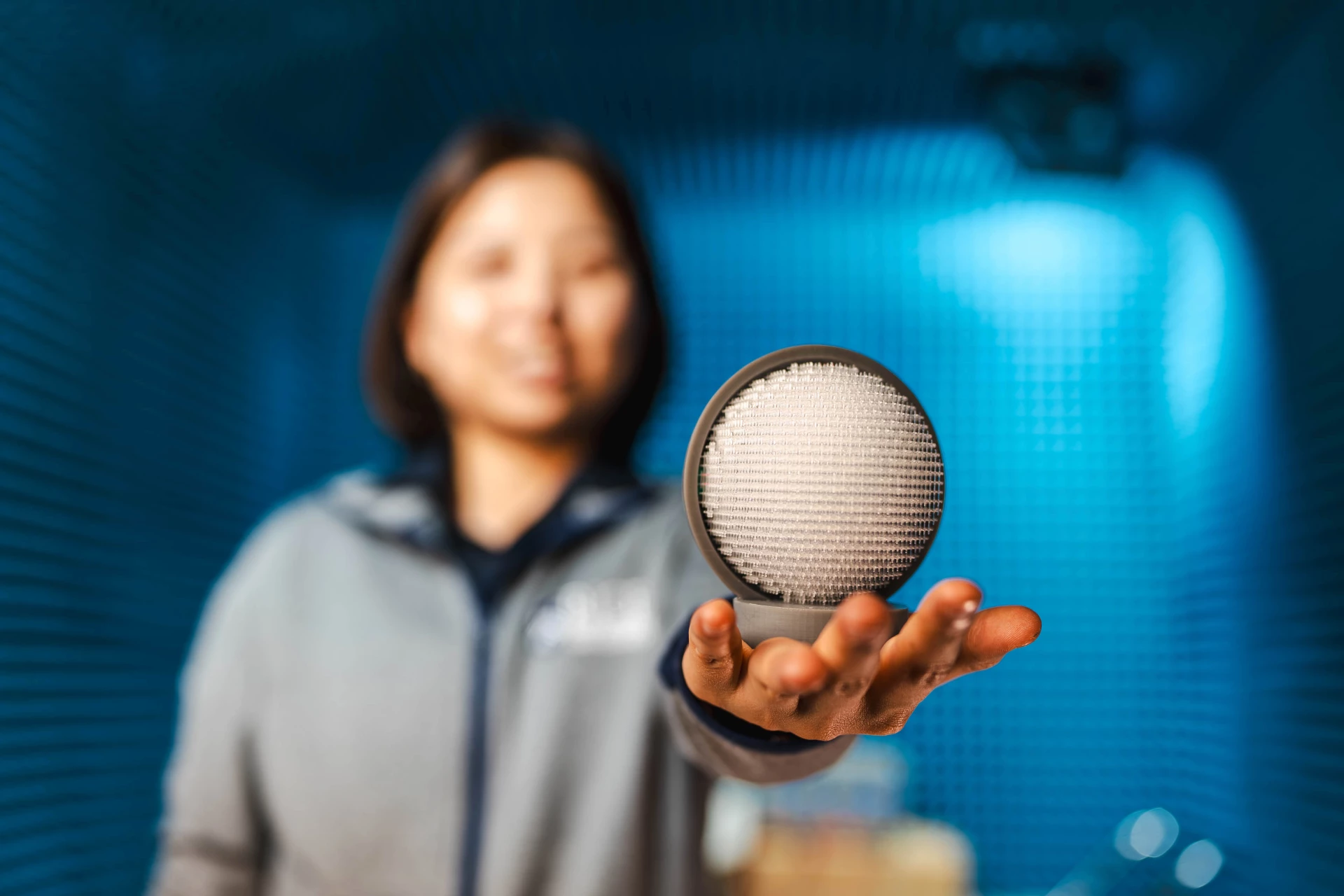

EyeDAR 的核心是一只约橙子大小的传感单元,由类似“晶状体”和“视网膜”的两部分组成:前端是利用 3D 打印技术制成的 Luneburg 超材料透镜,用于将不同方向来的无线电信号精准聚焦到固定焦点;其后是一排紧密布置的天线阵列,负责接收并解析这些聚焦信号的空间信息,然后反馈给汽车雷达系统。 与传统需要大规模天线阵列与复杂数字计算来完成波束成形和信号处理的雷达方案不同,EyeDAR 依靠透镜物理结构本身完成大量“预处理”工作,大幅简化电子硬件和算法负担。

研究团队介绍,这枚透镜由超过 8000 个形状各异、折射率不同的微小单元构成,每个单元的位置和参数都经过精细设计,使整体材料能够在电磁波通过时实现特定方式的弯折和聚焦,其本质是一种“硬件写死”的模拟信号处理器。 通过这种超材料结构,EyeDAR 能在光速传输过程中“即时”完成空间信息的预计算,省去了传统雷达中大量耗时、耗能的数字处理环节。 实验结果显示,该系统在解析目标方向速度上可以比传统雷达快 200 多倍,被视为模拟处理相较数字处理的一次显著性能飞跃。

与常规路侧雷达或主动发射设备不同,EyeDAR 本身并不产生新的电磁波,而是专注于采集来自车辆探测目标后向外散射的“残余”回波,再进行过滤和重构,并将“清洗”后的信号反射回车载雷达。 研究人员认为,这种紧凑、低成本、架构简单且依托超快模拟处理的设计,有望支持在城市道路和高速公路沿线进行大规模铺设,从而形成一个为自动驾驶车辆“远视”和“透视”服务的基础设施网络。

不过,制造业专家 Emeka Moronu 对该方案能否真正落地仍持谨慎态度。 他指出,尽管理论模型和实验数据令人振奋,但要在实际生产中长期、稳定地复刻数以千计的微结构单元,并保证其在高温暴晒、严寒冰冻等极端户外环境下保持几何精度和性能,是一项极具挑战性的工程任务,这也可能成为 EyeDAR 走出实验室、走向规模化部署的最大门槛之一。

尽管前景存在不确定性,莱斯大学团队认为 EyeDAR 展示了路侧超材料雷达在自动驾驶安全领域的潜力。 一旦形成规模化部署,车辆可凭借这些“路边之眼”获取超出自车传感器探测范围的路况信息,提早察觉拐角处交通参与者和被大型遮挡物遮住的行人或车辆,从而提升整体交通系统的安全冗余。 研究者还预计,这项技术未来同样可拓展至无人机、机器人和安防监控等应用场景,为多种自主系统提供更可靠的环境感知支持。